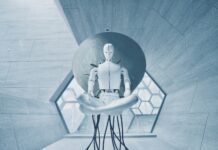

OpenAI използва GPT-4 за изграждане на система за модериране на съдържание

Модерирането на съдържанието е един от най-трудните проблеми в интернет от десетилетия. Тук имаме предвид субективността, която върви ръка за ръка с разбирането, какво съдържание трябва да бъде допустимо на дадена платформа.

Създателят на ChatGPT OpenAI смята, че може да помогне в тази област. Компанията подлага на изпитание уменията на GPT-4 за модериране на съдържание. Той използва мултимодален модел за изграждане на система за модериране на съдържание, която е мащабируема, последователна и персонализирана.

GPT-4 може не само да помогне при вземането на решения за модериране на съдържание, но и при разработването на бързо повторение на промените в политиката, намалявайки цикъла от месеци до часове. Моделът ще може да анализира различни регулации и нюанси в политиките за съдържание и незабавно да се адаптира към всякакви актуализации.

Положителна визия за бъдещето на дигиталните платформи

Това е едно ново начало определящо бъдещето на дигиталните платформи, където AI може да помогне за модериране на онлайн трафика според специфичната за всяка платформа политика. Това ще облекчи работата на голям брой човешки модератори. Всеки с достъп до OpenAI API може да приложи този подход, за да създаде своя собствена система за модериране, подпомагана от AI. Това ще съкрати работата на някои компании от месеци до един ден.

Ръчното преглеждане на травматично съдържание може да въздейства в психическо отношение върху модераторите. Това важи в пълна степен, ако става дума за графичен материал. Още през 2020 година, компании като Meta, платиха определени суми за компенсация за психическите проблеми на модераторите.

В подкрепа на човешкия фактор

Макар AI моделите далеч да не са перфектни, облекчаване на част от тежестта може да бъде от голяма полза. Много компании отдавна използват изкуствен интелект, който да подпомага процесите на модериране. Въпреки това често се стига до грешки. Предстои да разберем дали OpenAI ще съумее да избегне някои от основните капани на модерирането.

Въпреки това, хората не бива да бъдат изключвани от процеса. Езиковите модели все още са много уязвими относно нежелани отклонения. Някои от тях може да са били въведени неволно още в процеса на обучение. Всички резултати трябва да бъдат внимателно проверявани и валидирани. Именно поддръжката от хората ще ги усъвършенстват в цикъла на развитие.

Намаленото човешко участие в някои процеси на модериране може да помогне при фокусиране на човешките ресурси за справяне с крайните дилеми, които са необходими за усъвършенстване на политиката.